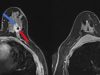

L’intelligenza artificiale sembra rilevare malattie dalle indagini di imaging con livelli di precisione simili a quelli degli operatori sanitari. Questa osservazione arriva da una revisione sistematica e meta-analisi pubblicata nei giorni scorsi sulla rivista The Lancet Digital Health.

Tuttavia, solo pochi studi erano di qualità sufficiente per essere inclusi nell’analisi e gli autori avvertono che il vero potere diagnostico della tecnica di intelligenza artificiale, noto come deep learning – l’uso di algoritmi, big data e potenza di calcolo per emulare l’apprendimento umano e intelligenza – rimane incerto a causa della mancanza di studi che confrontano direttamente le prestazioni di esseri umani e macchine o che convalidano le prestazioni dell’intelligenza artificiale in ambienti clinici reali.

Modelli di intelligenza artificiale

“Abbiamo esaminato oltre 20.500 articoli, ma meno dell’1% di questi erano sufficientemente robusti nella progettazione e nei rapporti tanto che i revisori indipendenti avevano fiducia nelle loro affermazioni. Inoltre, solo 25 studi hanno convalidato i modelli di intelligenza artificiale esternamente (utilizzando immagini mediche di una popolazione diversa) e solo 14 studi hanno effettivamente confrontato le prestazioni di intelligenza artificiale e professionisti della salute utilizzando lo stesso campione di test “, spiega il professor Alastair Denniston dell’University Hospitals Birmingham NHS Foundation Trust, del Regno Unito, che ha guidato la ricerca.

“All’interno di una manciata di studi di alta qualità, abbiamo scoperto che il deep learning poteva effettivamente rilevare malattie che vanno dai tumori alle malattie degli occhi, con la stessa precisione dei professionisti della salute. Ma è importante notare che l’intelligenza artificiale non ha sostanzialmente superato la capacità diagnostica umana.”

Intelligenza artificiale e deep learning

Con il deep learning, i computer possono esaminare migliaia di immagini mediche per identificare i modelli di malattia. Ciò offre un enorme potenziale per migliorare l’accuratezza e la velocità della diagnosi. Rapporti su modelli di deep learning che superano le prestazioni umane nei test diagnostici hanno generato molta eccitazione e dibattito. Oltre 30 algoritmi di intelligenza artificiale per l’assistenza sanitaria sono già stati approvati dalla Food and Drug Administration degli Stati Uniti.

Nonostante il forte interesse pubblico e le forze del mercato che guidano il rapido sviluppo di queste tecnologie, sono state sollevate preoccupazioni sul fatto che i progetti di studio siano distorti a favore dell’apprendimento automatico e in che misura i risultati siano applicabili alla pratica clinica del mondo reale.

Intelligenza artificiale in medicina: la revisione

Per fornire ulteriori prove, i ricercatori hanno condotto una revisione sistematica e una meta-analisi di tutti gli studi confrontando le prestazioni dei modelli di deep learning e dei professionisti della salute nel rilevare malattie da indagini di imaging, pubblicati tra gennaio 2012 e giugno 2019. Hanno anche valutato la progettazione dello studio, la comunicazione e il valore clinico.

In totale, 82 articoli sono stati inclusi nella revisione sistematica. I dati sono stati analizzati per 69 articoli che contenevano dati sufficienti per calcolare accuratamente le prestazioni del test. Stime aggregate di 25 articoli che hanno convalidato i risultati in un sottoinsieme indipendente di immagini sono state incluse nella meta-analisi.

Uomo e macchina a confronto

L’analisi dei dati di 14 studi che hanno confrontato le prestazioni del deep learning con gli esseri umani nello stesso campione ha scoperto che, nella migliore delle ipotesi, gli algoritmi di deep learning possono rilevare correttamente la malattia nell’87% dei casi, rispetto all’86% raggiunto dagli operatori sanitari.

La capacità di escludere accuratamente i pazienti che non hanno una malattia era simile per gli algoritmi di apprendimento profondo (specificità del 93%) rispetto ai professionisti della salute (91%).

“Esiste una tensione intrinseca tra il desiderio di utilizzare una nuova diagnostica potenzialmente salvavita e l’imperativo di sviluppare prove di alta qualità in modo che possano beneficiare i pazienti e i sistemi sanitari nella pratica clinica”, afferma il dott. Xiaoxuan Liu dell’Università di Birmingham, nel Regno Unito.

“Una lezione chiave del nostro lavoro è che nell’intelligenza artificiale, come in qualsiasi altra parte dell’assistenza sanitaria, è importante progettare bene lo studio. Senza di questo, puoi facilmente introdurre una distorsione dei tuoi risultati. Questi pregiudizi possono portare a pretese esagerate di buone prestazioni per gli strumenti di intelligenza artificiale che non si traducono nel mondo reale. Una buona progettazione di questi studi è una parte fondamentale per garantire che gli interventi di intelligenza artificiale che arrivano ai pazienti siano sicuri ed efficaci.”